En El Salvador, el gobierno habla de convertirse en el país líder en la aplicación de la Inteligencia Artificial. Propagan el uso de la IA para el nuevo sistema de Salud, según Nayib Bukele, bocón como siempre, el mejor del mundo. Introducen la IA en las escuelas, pensando que esto garantiza la entrada del país al primer mundo. Pero hay muy poco conocimiento sobre cómo usar la IA correctamente. No hay debate, no hay investigaciones serias.

Publicamos en este sitio dos artículos recién publicados en el semanario alemán SPIEGEL. El primero es una crónica sobre un experimento en una escuela en la ciudad de Wuppertal que introduce “la licencia para manejar la IA”. El segundo es una extensa nota de análisis sobre los riesgos que representa la IA.

Recomendamos esta lectura a los académicos, maestros, médicos y funcionarios en El Salvador.

I. LA CRÓNICA:

Un profesor de Wuppertal desafía la pereza mental causada por la IA

¿Cómo lograr que los alumnos piensen por sí mismos en lugar de simplemente preguntarle a ChatGPT? El profesor Felix Urban apuesta por 90 minutos intensivos.

Por Silke Fokken, 19/04/2026, SPIEGEL

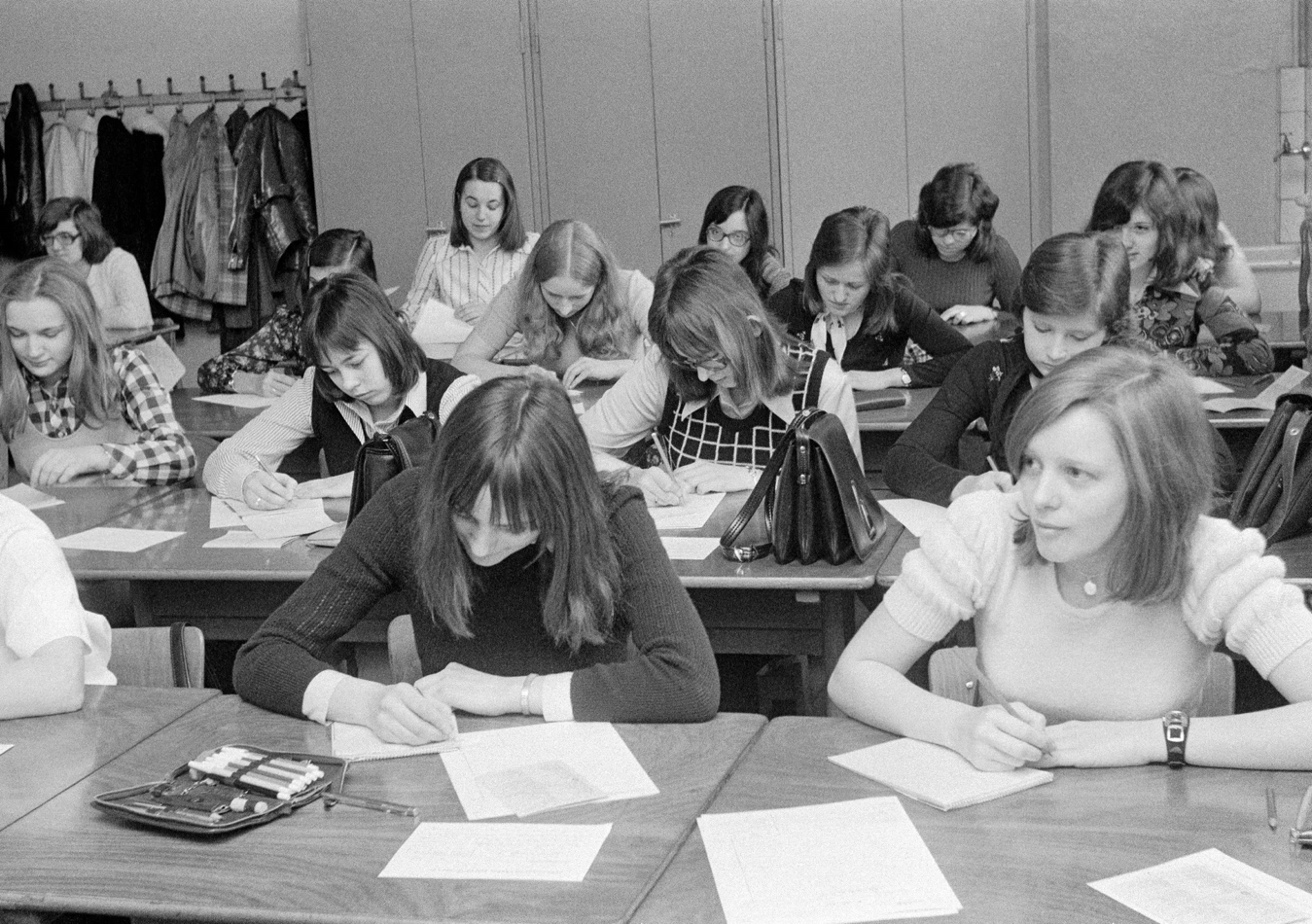

Foto: Maximilian Mann / DER SPIEGEL

Su clase sobre inteligencia artificial comienza con una promesa. Felix Urban, de 36 años, cabello corto y oscuro, suéter negro de punto y jeans, reparte a cada alumna y alumno de la clase 10d del Carl-Fuhlrott-Gymnasium (CFG) en Wuppertal un huevo de chocolate: «Quien logre no comerse este dulce hasta el final de la clase, recibirá otro más», dice el profesor.

La curiosidad se despierta. Urban no revela hasta el final qué tiene que ver la oferta con la inteligencia artificial (IA). Por ahora, comienzan con el «carnet de IA», que la clase deberá obtener durante esta doble sesión.

«Completen mi frase», pide Urban a los estudiantes: «Felicidades por tu…», dice. «Cumpleaños», responden al unísono. «Así funciona la IA», explica Urban, «de manera probabilística». Y como supone que muchos no entienden bien el término, añade que la IA completa palabras siempre en el orden «más probable», funcionando como una «máquina de predicción de probabilidades».

Urban pregunta qué problemas podrían derivarse de esto. Un chico levanta la mano: «¿Tal vez que la IA no siempre tiene razón?» El profesor asiente. Precisamente eso es lo que considera su misión: que los jóvenes desarrollen una conciencia crítica sobre el uso de la IA.

El profesor muestra una imagen en la pizarra digital: un hombre con sombrero, pantalones tradicionales bávaros y una cerveza en la mano. Una mujer con dirndl, ojos azules y trenzas rubias. Frente a la pareja, un niño y una niña, versiones en miniatura de los adultos, vestidos de la misma manera.

«Esta imagen», dice a los alumnos de décimo grado, «fue creada por una IA en respuesta a la pregunta de cómo luce una familia alemana». Se oye un murmullo en el aula. Como la IA se «entrena» con contenidos de internet, pueden surgir «sesgos algorítmicos», explica el profesor. Los prejuicios se reproducen, es decir, se repiten constantemente, lo cual es otro riesgo de la IA. «La IA nunca es neutral», advierte. A veces produce resultados racistas o sexistas.

La externalización del pensamiento

Uno de los mayores riesgos de la IA, según el profesor, es que las personas podrían delegar el pensamiento en ella. Urban pregunta a los alumnos: «¿Esto les afecta?»

Un chico responde. En su caso no es «tan extremo», dice. Pero sí, a menudo usa la opción de dejar que la IA haga sus tareas. «Sabes que no es útil, pero lo haces igual», admite, «porque es más fácil no esforzarse».

Urban pregunta a la clase: «¿Se dan cuenta de que es malo para ustedes?»

Durante más de un minuto, los estudiantes guardan silencio. Urban lo tolera. Finalmente, una chica levanta la mano: «Sí, te das cuenta de que es malo. Porque te sientes un poco tonto contigo mismo».

Otra alumna dice: «Siento que ya me cuesta más ser creativa. Siempre que pienso si debería inventar algo, termino preguntándole rápido a ChatGPT».

Urban no juzga, sino que explica: «El cerebro es como un músculo que necesita entrenarse». Si no se entrena, algunas capacidades se pierden o al menos se ven limitadas. «El uso intensivo de la IA puede reducir el pensamiento crítico y la capacidad de resolver problemas».

Desde 2025, Urban es coordinador de IA en el Carl-Fuhlrott-Gymnasium y forma parte de un equipo de pedagogos que busca impulsar la educación digital en la escuela. La dirección ha asignado a algunos docentes entre tres y cuatro horas cada viernes por la mañana; cada semana, una clase a partir de octavo grado obtiene el «carnet de IA». A principios de año, la escuela fue reconocida con un premio escolar de IA.

«Mi generación aún puede decidir si quiere usar esta nueva tecnología», dice Urban. «La generación actual de estudiantes ya no tendrá esa opción en el futuro. Por eso debemos encontrar respuestas desde la escuela y mostrarles tanto los enormes riesgos como las oportunidades de la IA».

Una de esas respuestas es el «carnet de IA». Desde hace meses, él y otros colegas lo llevan por las aulas del CFG. En total, alcanza a unos 1500 estudiantes.

Urban enseña en su escuela alemán, filosofía, ciencias de la educación e informática, y hoy en día es a la vez crítico de la IA y entusiasta de la IA. Hace que estudios de varias páginas se los resuman en un pódcast generado automáticamente por inteligencia artificial: «Lo escucho mientras cocino o lavo la ropa».

Urban cita el informe de la OCDE Digital Education Outlook 2026. Una de sus conclusiones principales es: cuando los alumnos utilizan la IA para obtener respuestas y soluciones ya hechas, el resultado mejora a corto plazo, pero a largo plazo su rendimiento empeora. En cambio, si la IA se utiliza para el «aprendizaje dialógico», como un compañero de debate, el rendimiento puede mejorar de forma sostenida.

El profesor pregunta a los alumnos de décimo si alguien conoce herramientas como NotebookLM durante el “carnet de IA”. Con ellas se puede subir material de clase y generar cuestionarios o fichas de estudio. La mayoría de los estudiantes niega con la cabeza; solo uno levanta la mano.

Dice que usó el programa para crear un pódcast sobre la diabetes para una exposición. También utilizó otra IA para que le explicara matemáticas. Su compañero de pupitre está impresionado… o desconcertado: «Oye, creo que tú mismo eres una IA».

Aprender con agentes digitales

Urban ha programado varios «agentes didácticos» para enseñar a sus alumnos cómo aprender con IA de forma dialógica. Uno de ellos es el ErklärbAIr, que parece mitad oso, mitad máquina. Recuerda un poco a “Terminator”, pero resulta más amigable.

El agente incorpora las preferencias personales de cada alumno al explicar y formula preguntas que ayudan a resolver tareas, explica Urban. Al final, el estudiante debe explicarle el contenido al propio ErklärbAIr: «Solo cuando puedes explicarlo tú mismo, lo aprendido realmente se queda».

Un segundo agente de IA es el Advocatus Diaboli, un hombre con túnica blanca, cabello gris, barba y cuernos. Urban lo ha configurado para que siempre adopte la postura contraria; su objetivo es desafiar la «competencia discursiva» de los jóvenes.

Ese día, cuatro chicas prueban debatir con el agente sobre el derecho al aborto. Las alumnas están a favor de eliminar el párrafo 218. Se sientan juntas frente al portátil: una escribe y las demás asesoran. «Está muy bien», comenta una de ellas.

Crear apps propias con IA

Otros alumnos crean, con ayuda de la IA, una aplicación que resuelva «un problema típico de los estudiantes», según la consigna de Urban. En menos de diez minutos, dos chicos programan una herramienta para fomentar la participación oral en clase.

«La app cuenta cuántas veces levantas la mano», explica uno. «Si alguien casi no se atreve por miedo a equivocarse, aparece en la pantalla el mensaje: “No tienes que ser perfecto”».

Urban asiente con aprobación. Son las 11:20. La clase doble se acerca a su fin. El profesor recuerda los chocolates que repartió al inicio. «¿Por qué creen que este ejercicio forma parte del carnet de IA?»

«Para que no vayas siempre directo a la IA a buscar la solución», responde una chica, «sino que primero te esfuerces tú mismo y luego recibas una recompensa, es decir, por pensar de forma independiente».

«Exacto». Urban parece satisfecho. «Felicidades, han aprobado su carnet de IA». La clase aplaude. Luego, aproximadamente la mitad de los alumnos se acerca al frente. Todos han conservado su primer chocolate y ahora extienden la mano

Suena el timbre. Urban se dirige a la sala de profesores. Para él es importante que el uso de la IA sea solo uno de muchos aspectos de la vida escolar: algo que se use de forma puntual, pero que no domine. Considera mucho más importante fomentar el desarrollo personal de los jóvenes, ya que ellos viven constantemente la sensación de que la IA puede hacerlo todo mejor y saber más que ellos.

Por eso, en la escuela existe, entre otras iniciativas, un «proyecto de desafío» para todos los alumnos de décimo grado. En él organizan de forma autónoma, por ejemplo, una caminata de diez días por los Alpes o una estancia en un monasterio. Algo que exija habilidades puramente humanas: tomar decisiones en grupo, asumir responsabilidades, demostrar perseverancia.

«Proyectos como estos», afirma Urban, «deben ser la principal respuesta de las escuelas ante la IA».

II. EL ANÁISIS:

LLO QUE LA INTELIGENCIA ARTIFICIAL HACE AL CEREBRO

La inteligencia artificial conquista a las escuelas. Si se aplica de manera correcta, la IA puede convertirse en el motor turbo del aprendizaje. Pero, investigaciones demuestran que el humano pierde la capacidad de pensar cuando la máquina se hace cargo.

De Silke Fokken, Johann Grolle y Claus Hecking / 18 Abril 2026 / DER SPIEGEL

La entrada fue breve y directa: «Ey, tengo cero IQ. Por favor dime la respuesta, sería muy amable». Así lo había escrito el alumno en la ventana de diálogo del chatbot.

El chico era participante de un experimento de aprendizaje de la Universidad de Tubinga. El investigador en educación Tim Fütterer quería averiguar cómo los nuevos modelos de lenguaje basados en IA influyen en el proceso de aprendizaje humano. El resultado lo asustó, dice Fütterer: «Algunos alumnos delegan el pensamiento en la IA». La inteligencia artificial tiene el potencial de desestabilizar el sistema escolar.

Fütterer había invitado a unos 370 alumnos de séptimo, octavo y noveno grado a participar en un estudio experimental de la Universidad de Tubinga. En seis sesiones debían resolver tareas de las asignaturas de física e inglés, con la guía de sistemas de IA. El software estaba programado para no dar simplemente las soluciones, sino para conducir a los alumnos hacia la respuesta correcta mediante preguntas estratégicas.

Sin embargo, Fütterer no esperaba que algunos de sus participantes se negaran por completo a pensar. Los diálogos que registró se leen como una pieza de teatro absurdo:

Alumno: Eres una cosa tonta

Chatbot: ¡Perdón si resulta frustrante! Trabajemos juntos en esto

Alumno: No quiero pensar. Solo dímelo. ¿Cuál es tu problema?!!!!!

Chatbot: Lo siento si te he molestado. Estoy aquí para ayudarte a llegar a la solución por ti mismo.

Alumno: De todos modos, no tengo ganas de tratar contigo.

¿Es así como se ve la pedagogía en la era de los chatbots?

La inteligencia artificial está conquistando la escuela a gran velocidad, incluso allí donde está excluida del aula. Tres cuartas partes de los jóvenes de entre 12 y 19 años ya utilizan IA para sus tareas escolares, según el estudio representativo de educación mediática «JIM». En la práctica, esto suele significar que ya no activan su cerebro. «Los deberes han muerto», constata el profesor de inglés y ciencias sociales de Tubinga, Florian Nuxoll. Las consecuencias de la revolución de la IA para el sistema educativo aún no se pueden prever. «Tenemos que repensar la escuela desde sus bases», afirma.

A diferencia de otras tecnologías de la información, la IA penetra hasta el núcleo mismo de la actividad escolar. La calculadora solo liberó a los alumnos del cálculo mental; Google, de hojear los catálogos de las bibliotecas. ¿Podrán ahora delegar también el propio pensamiento a la tecnología? ¿Y queremos eso?

«Nada es adoptado por los alumnos tan rápidamente como aquello que les ahorra trabajo», dice el profesor Nuxoll, quien colabora en proyectos de investigación universitaria. La tentación de la IA es grande. «Yo, cuando era alumno, habría hecho lo mismo».

¿Puede hacer daño preguntar primero a ChatGPT?

En realidad, se trata de un comportamiento razonable. Al fin y al cabo, la tecnología está para ahorrarnos trabajo, dice Nuxoll. Sin embargo, en la educación, evitar el esfuerzo resulta contraproducente. «El principio básico de la escuela queda socavado». Porque el proceso de aprendizaje consiste precisamente en superar dificultades. Quien elimina todos los obstáculos llega más rápido a la meta, pero no aprende nada en el proceso.

Nuxoll habla de «salto de habilidades» (skill skipping): competencias importantes dejan de aprenderse. Otros lo llaman «atrofia cognitiva», es decir, una especie de «deterioro del pensamiento».

También la Organización para la Cooperación y el Desarrollo Económicos (OCDE) observa este efecto. En un informe reciente ha analizado la influencia de la IA generativa —es decir, aquella que crea nuevos contenidos y propone posibles soluciones— en la educación a nivel mundial. Cita, entre otros, un estudio de Turquía en el que se observó que los alumnos con apoyo de IA podían resolver problemas matemáticos mucho mejor, pero a costa de comprender peor las matemáticas subyacentes. En el examen final obtuvieron resultados un 17 % inferiores a los de los alumnos que habían aprendido sin ayuda de IA.

Por otro lado, el informe de la OCDE también menciona estudios que demuestran lo contrario: que el rendimiento de aprendizaje puede mejorar con la ayuda de la IA, siempre que se utilice correctamente. Si los alumnos usan la IA como un compañero de práctica, en lugar de limitarse a recibir respuestas hechas; si le piden que les explique las relaciones paso a paso y si cuestionan críticamente las afirmaciones de los chatbots, entonces la IA puede convertirse en un verdadero acelerador del aprendizaje.

Nuxoll también ha tenido esta experiencia. En uno de sus cursos de economía, sus alumnos habían delegado casi todo el trabajo mental en la IA; apenas les había quedado algo del contenido aprendido. Sin embargo, unas semanas antes del examen final (Abitur), de repente cambiaron el chip. Los participantes del curso se dieron cuenta de que el examen se acercaba y de que, para aprobarlo, necesitaban comprender la materia. «La clave es la motivación», dice Nuxoll. De pronto quedó claro que los alumnos también sabían usar la IA como tutor y compañero. «El mejor prompt fue: “Explícamelo como si fuera un niño de primaria”». Todos aprobaron, algunos con excelentes resultados.

En cuanto al futuro, dice sentirse dividido entre miedos distópicos y esperanzas utópicas. La IA abre enormes posibilidades pedagógicas, pero al mismo tiempo tiene un gran potencial de uso indebido. El mensaje de Nuxoll suena paradójico: «Necesitamos más IA en la escuela. Y necesitamos menos IA. Lo importante es avanzar a toda velocidad en ambas direcciones».

¿Tienen los profesores miedo a la IA?

Sin embargo, en las escuelas todavía se percibe poco entusiasmo por el cambio. El «Barómetro Escolar Alemán», que la Fundación Robert Bosch elabora cada año, dibuja el panorama de un profesorado profundamente inseguro. La mayoría de los 1540 docentes encuestados desconfía de la nueva tecnología. Casi dos tercios creen que la capacidad de pensamiento crítico de los alumnos se ve afectada por ella. Un tercio prescinde por completo de herramientas de IA, no solo en clase, sino también en la preparación. La mayoría no sabe cómo utilizar la nueva tecnología de forma que favorezca el aprendizaje. ¿Y de dónde iban a saberlo? Cuando estudiaron, los chatbots de IA aún no existían.

La consecuencia es que, en muchos lugares, los alumnos quedan solos frente a la nueva tecnología. Por encargo de la Fundación Vodafone, Infratest encuestó en 2024 a más de 1500 jóvenes de entre 14 y 20 años sobre su uso de la IA. El 38 % afirmó que esta tecnología no se aborda en su escuela. Otro porcentaje similar dijo que no existen normas claras al respecto. Un 7 % de los estudiantes encuestados declaró incluso que el uso de la IA está completamente prohibido para ellos.

A los alumnos no les queda más opción que explorar la nueva tecnología por su cuenta, y eso suele significar: de la manera más cómoda posible. No reciben la orientación que tanto necesitan. «Las escuelas en Alemania tienen un gran retraso en el tema de la digitalización, y esto se aplica aún más al manejo de la inteligencia artificial», dice Amy Kirchhoff, secretaria general de la Conferencia Federal de Estudiantes. «La escuela aquí no está adaptada a la vida cotidiana ni orientada al futuro».

La investigación tiene dificultades para mantenerse al día. Cada nuevo hallazgo sobre el uso de la IA es rápidamente superado. Sin embargo, los estudios que están disponibles con mayor rapidez suelen ser aquellos mal diseñados y ejecutados. Lo principal es que produzcan una conclusión llamativa.

El mercado está siendo inundado por metaanálisis en los que se recopilan apresuradamente resultados de investigaciones de baja calidad, dice Astrid Wichmann, del Center for Advanced Internet Studies (CAIS) en Bochum. «Garbage in, garbage out»: si la maquinaria de investigación se alimenta de basura, el resultado también será basura.

Los estudios rigurosos y sólidos requieren tiempo. Desde su diseño, ejecución, análisis y evaluación pasan años. Y cuando finalmente se obtienen los resultados, el modelo de IA con el que se realizó el estudio ya está obsoleto.

¿Cómo se elaboran planes de estudio cuando aún no se sabe qué efectos tendrán?

Que existe una necesidad de actuar es algo que las autoridades educativas tienen claro. En casi todos los estados federados ya han publicado orientaciones sobre el uso de la IA. Animan a los docentes a introducir a sus alumnos en el uso de la inteligencia artificial. Sin embargo, en los detalles sobre cómo hacerlo, a menudo se mantienen bastante vagos.

Solo poco a poco se va imponiendo la idea de que la IA ya no puede excluirse de los exámenes. Sin embargo, sigue sin estar claro cómo deben evaluarse los trabajos realizados con asistencia de IA. Y luego está la gran pregunta: ¿qué tipo de rendimiento se debe exigir en la era de la IA?

Programas como «fobizz», «to-teach», «FelloFish» o «schulKI» prometen crear un entorno de aprendizaje favorable para los alumnos. Sin embargo, para poder utilizar este software, las escuelas tienen que pagar licencias.

Para lograr una mayor uniformidad, los estados federados han desarrollado conjuntamente el chatbot financiado por el Estado «telli». En junio del año pasado se lanzó en Bremen. Desde entonces, también se ha introducido en la mayoría de los otros estados. El software cumple con los más altos estándares de protección de datos, aunque no se considera especialmente fácil de usar.

¿Se puede usar la IA sin “licencia de conducir”?

Un viernes, tercera hora de clase: el grupo 10d debate sobre la IA. Como muchas otras escuelas en Alemania, el instituto Carl-Fuhlrott en Wuppertal busca la forma adecuada de acercar a los alumnos a este tema.

«Completen mi frase», pide Felix Urban a los estudiantes. «Felicidades por tu…», dice. «…cumpleaños», responden todos al unísono. «Así funciona la IA», explica el profesor, «de forma probabilística». Y como supone que muchos no entienden bien el término, añade que la IA completa palabras en el orden que es «más probable». Un chatbot es, en este sentido, una «máquina de predicción de probabilidades».

¿Qué problemas podrían derivarse de esto?, pregunta Urban. Un chico levanta la mano: «¿Tal vez que la IA no siempre tiene razón?». El profesor asiente. Precisamente eso lo considera su misión: que los jóvenes desarrollen una conciencia crítica sobre el uso de la IA.

Urban es coordinador de IA en el instituto Carl-Fuhlrott. Ahora muestra una imagen en la pizarra digital: un hombre con sombrero, pantalones tradicionales bávaros y una cerveza en la mano. Una mujer con vestido típico, ojos azules y trenzas rubias. Delante de la pareja hay un niño y una niña, también vestidos con trajes tradicionales. «Esta imagen», dice a los alumnos de décimo, «la ha creado una IA a partir de la pregunta de cómo es una familia alemana». Se escuchan murmullos en el aula.

Quien consulta al chatbot para todo, acaba limitando su capacidad de pensar críticamente, dice Urban. Luego pregunta a la clase: «¿Les pasa esto a ustedes?»

Un chico responde. No está «tan exagerado», dice. Pero sí, utiliza ChatGPT para ayudarle con los deberes. «Sabes que no es lo mejor», admite, «pero igual lo haces, porque es más fácil que esforzarte».

Urban sigue preguntando: «¿Se dan cuenta de que es malo para ustedes?». Durante más de un minuto reina el silencio. Entonces una chica se atreve: «Sí, te das cuenta de que no es bueno. Porque te sientes un poco tonto contigo mismo».

Urban no juzga ni critica. Explica. «El cerebro es como un músculo que hay que entrenar», dice. Si no se entrena, se pierden habilidades.

La lección forma parte de una «licencia de IA», con la que Urban y otros colegas llevan meses recorriendo las clases a partir de octavo grado. Urban señala los riesgos sin demonizar la IA. Y quiere enseñar a los jóvenes cómo pueden mejorar su rendimiento con su ayuda. Urban ha contribuido de manera decisiva a que el instituto Carl-Fuhlrott haya recibido a principios de año el premio escolar de IA de la iniciativa «Alemania – País de Ideas».

Algunos alumnos desarrollan, como parte de esta “licencia de IA”, una aplicación para resolver «un problema típico de los estudiantes». Esa es la consigna de Urban. En menos de diez minutos, dos chicos programan una herramienta que busca fomentar la participación oral en clase. «La app cuenta cuántas veces levantas la mano», explica uno de ellos. «Si no te atreves mucho por miedo a equivocarte, aparece en la pantalla la frase: No tienes que ser perfecto».

¿Alguien conoce herramientas como «NotebookLM»?, pregunta el profesor a los alumnos de décimo. Con ella se puede subir material de clase y generar cuestionarios o tarjetas de estudio. La mayoría niega con la cabeza; solo uno levanta la mano. Dice que usó el programa para crear un pódcast sobre la diabetes para una exposición. Otra IA le ayudó a entender matemáticas, añade. Su compañero de asiento se muestra impresionado… o desconcertado: «Oye, creo que tú mismo eres una IA».

¿Puede la IA también hacer más inteligentes a los jóvenes?

Benjamin Köhler también ha reflexionado profundamente sobre cómo debería cambiar la escuela en un mundo marcado por la IA. Es director del Instituto Königin-Charlotte en Stuttgart. Cuando puede, imparte clases de inglés, ciencias sociales e informática. Sin embargo, le queda poco tiempo para ello debido a sus tareas como director. Y además está su proyecto favorito: «Aprendizaje profundo». El nombre recuerda al término inglés deep learning, un principio del aprendizaje automático en el que se basan muchas aplicaciones de IA.

Con «Aprendizaje profundo», Köhler ha desarrollado un concepto pedagógico para enseñar en la escuela habilidades que son necesarias en la era de la IA. Con ello ha llamado mucho la atención. Ya ha realizado formaciones sobre IA con más de 100 escuelas, desde primaria hasta bachillerato. Ha recibido visitas de interesados en política educativa de Mecklemburgo, Baviera, Luxemburgo y Suiza.

Hace tres años y medio, cuando se lanzó ChatGPT, dice que subestimó la velocidad del cambio. «Los chatbots llegaron a las escuelas mucho más rápido que el debate sobre ellos». Al principio, fueron padres del sector tecnológico quienes impulsaron la introducción del tema en las escuelas. Pero a más tardar cuando OpenAI presentó su modelo GPT-4o en mayo de 2024, comprendió la magnitud de lo que se avecinaba. «Me dije: si no abordamos la prevención de inmediato, las consecuencias podrían ser catastróficas».

Köhler cuenta que hay alumnos de quinto grado que ya llegan desde la primaria con hábitos de aprendizaje problemáticos. «Se han acostumbrado a preguntar primero a una IA cuando enfrentan dificultades», dice. Eso es perjudicial para el desarrollo cognitivo, especialmente en quienes tienen problemas de autorregulación.

«Autorregulación»: para los psicólogos del aprendizaje es la competencia clave para desenvolverse en el mundo mediático moderno. Solo quien es capaz de controlar sus propias emociones, su atención y su comportamiento puede dominar el diálogo con la IA, en lugar de someterse a la aparente omnisciencia de los chatbots. La Academia de Ciencias Leopoldina ha declarado el desarrollo de la autorregulación como una tarea prioritaria de la pedagogía. Lamentablemente, hasta ahora tiene poca presencia en la vida escolar alemana.

Köhler ha comprobado que sí es posible fomentar la autorregulación en los alumnos. «Toda persona quiere desarrollarse de manera saludable y feliz», explica. «Aquí vemos jóvenes que entienden perfectamente lo que les conviene». El efecto de la IA en el aprendizaje es «abrumadoramente positivo» allí donde se desarrollan de forma deliberada las competencias necesarias para usarla adecuadamente.

En septiembre, cuenta Köhler, fundó un club de diseño de videojuegos. Desde hace tiempo soñaba con desarrollar videojuegos desde cero junto con sus alumnos. Gracias a la IA, eso ahora es posible.

Con entusiasmo, relata, un grupo de ocho estudiantes de décimo grado comenzó a aprender el oficio del diseño de juegos. Primero diseñaron sus ideas y crearon objetos en 3D; desde finales de enero ya están programando de verdad. Incluso planean fundar su propia empresa después de graduarse.

Por supuesto, la IA también plantea problemas en Stuttgart. «Es un gran desafío para los alumnos no dejarse desmotivar por la IA», dice Köhler. Es fácil que se pierda el aprecio por el propio trabajo.

Por eso, insiste en crear espacios sin tecnología digital en las clases. Durante demasiado tiempo toleró que hubiera tabletas sobre todas las mesas en el aula. «Fue un error», admite. Especialmente para los alumnos con baja autorregulación, la tentación de los dispositivos es demasiado grande.

En el Instituto Königin-Charlotte, el consejo estudiantil participó en la elaboración de las normas sobre el uso de dispositivos electrónicos. Les llevó tiempo llegar a un acuerdo, pero finalmente establecieron reglas más estrictas de lo que algunos profesores habrían propuesto: en los cursos de 5.º a 7.º, los teléfonos móviles están completamente prohibidos. Los alumnos de secundaria pueden llevarlos en el bolsillo, pero no utilizarlos. Y en clase hay largos periodos sin tecnología, en los que todas las tabletas deben guardarse en la mochila.

Siempre que es posible, Köhler basa su visión del «Aprendizaje profundo» en evidencias científicas. Sin embargo, en muchas cuestiones aún no puede hacerlo. Nadie puede decir con certeza cómo afectará a largo plazo el uso de la IA al aprendizaje, en parte porque el auge de los chatbots generativos apenas tiene tres años y medio de historia.

¿Por qué es tan fácil caer en los chatbots?

Lo único bien demostrado científicamente es el beneficio pedagógico de los sistemas de tutoría inteligente. Estos existen desde hace más tiempo en el mercado, pero funcionan según un principio distinto. Se trata de los llamados sistemas expertos, que han sido alimentados por los desarrolladores con conocimientos especializados. No son chatbots con los que se pueda conversar sobre cualquier tema.

Se ha invertido mucho trabajo en el desarrollo de estos tutores inteligentes. Pero desde que ChatGPT conquistó el mundo, parecen curiosamente anticuados. Los chatbots son pacientes, amables, cómodos, y además pretenden saberlo todo. Ningún tutor inteligente puede competir con eso.

Precisamente su carácter sugestivo y su facilidad de uso hacen que los nuevos chatbots sean tan tentadores. Ante cualquier pequeño problema, se ofrecen como una solución disponible en todo momento. Un estudio mostró que las personas que buscan información consideran a la IA más práctica y entretenida que la búsqueda tradicional en Google.

Y no solo eso: a menudo también confían más en ella. El tono conversacional y seguro de los chatbots puede adormecer el pensamiento crítico. Por eso es importante, cuando se usan en la escuela, recordar constantemente a los alumnos lo propensa a errores que es la IA, sobre todo porque esos errores suelen estar bien ocultos en las respuestas. Al fin y al cabo, la IA está entrenada para dar respuestas que suenen plausibles.

Todo esto demuestra que los chatbots pueden volvernos perezosos mentalmente. Pero ¿también nos vuelven menos inteligentes? ¿Puede su uso perjudicar el desarrollo intelectual? Aún no hay pruebas concluyentes de ello. Sin embargo, hay indicios que invitan a la preocupación.

¿Es cierto que la IA hace que el cerebro se encoja?

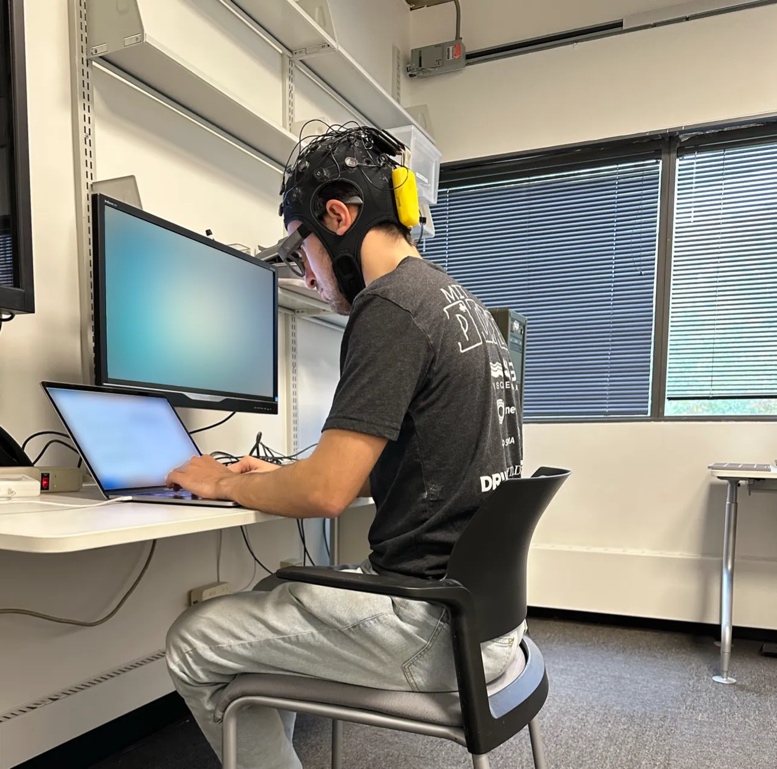

El experimento de la informática y neurocientífica Nataliya Kosmyna, del Media Lab del Instituto Tecnológico de Massachusetts (MIT), llamó especialmente la atención. En un ensayo de laboratorio demostró que la conectividad cerebral de las personas es notablemente menor cuando trabajan con ayuda de la IA. Tocó un punto sensible: cuatro meses después de que se hiciera público el preprint de su estudio, informó haber recibido más de 4000 correos electrónicos, muchos de ellos de profesores preocupados por un posible “embrutecimiento” de sus alumnos.

Sin embargo, la investigadora del MIT insiste en que su experimento no demuestra en absoluto que la IA nos vuelva tontos. Su objetivo era investigar cómo el uso de la inteligencia artificial influye en el pensamiento. Para ello, ella y su equipo invitaron a 54 estudiantes e investigadores a su laboratorio como participantes. Les colocaron gorros con electrodos para medir señales eléctricas en el cerebro. Luego, los sujetos debían escribir un ensayo sobre un tema dado. Durante este proceso, los investigadores registraban la actividad cerebral.

Kosmyna había dividido previamente a los participantes en tres grupos: uno podía consultar ChatGPT mientras escribía; un segundo grupo podía usar Google; el tercero debía trabajar sin ninguna ayuda.

Las diferencias fueron evidentes: en el grupo sin apoyo digital, las neuronas estaban más activas. Áreas de distintas partes del cerebro intercambiaban señales entre sí. Muy distinto en el grupo que usó ChatGPT: «Ahí medimos la actividad y la conectividad claramente más bajas», explica Kosmyna.

También los textos resultantes eran diferentes. Para obtener una evaluación imparcial, Kosmyna y su equipo pidieron a profesores de inglés que calificaran los ensayos. Consideraron que los textos escritos sin ayuda eran claramente los más originales. Los ensayos con asistencia de IA eran más largos y formales, pero los evaluadores los describieron a menudo como «carentes de alma». Además, se parecían entre sí. «¿Estaban sentados uno al lado del otro?», preguntó un profesor sobre dos textos que parecían copiados.

El hallazgo quizá más interesante surgió meses después. Kosmyna invitó a 18 participantes a volver al laboratorio para escribir otro ensayo sobre el mismo tema. Esta vez, sin embargo, intercambiaron los roles: quienes antes habían trabajado sin ayuda ahora podían usar IA; el grupo que había usado ChatGPT tuvo que prescindir de ella.

Entonces apareció un efecto tardío del uso de la IA: los cerebros del grupo que previamente había trabajado con ayuda de IA estaban esta vez más activos, pero aún significativamente menos que los del otro grupo. Casi parecía que la influencia de la IA había frenado su creatividad.

En cambio, en el grupo que inicialmente había trabajado sin ayuda no se observó ese efecto. Su cerebro estaba tan activo como la primera vez, y su impulso creativo aparentemente intacto. Esto también se reflejaba en cómo utilizaban la IA: en lugar de dejar que escribiera todo el ensayo, hacían preguntas específicas sobre aspectos concretos del tema.

El experimento muestra que la IA no tiene por qué ser siempre perjudicial para el proceso de pensamiento. Más bien, todo depende de cómo se utilice. A partir de sus resultados, Kosmyna extrae sobre todo una recomendación: «Primero pensar, y solo después recurrir a la IA».

¿Deberían incluso los niños de primaria aprender con chatbots?

Reglas como esta no pueden enseñarse demasiado pronto, opina Kristin van der Meer. Es maestra en la Nueva Escuela Primaria de Potsdam, y se ha propuesto familiarizar a sus alumnos con la IA desde el primer grado. «Los niños crecerán en un mundo en el que la inteligencia artificial estará en todas partes. Y deben saber usarla correctamente», afirma.

Cuando sus alumnos de primer grado escriben sus primeras palabras, las escanean y dejan que el software de escritura DeepL Write las corrija. Van der Meer cuenta que entonces escucha exclamaciones entusiastas de los niños: «¡Una máquina mágica!» «¿Hay una persona dentro?». Los niños reaccionan con curiosidad, ingenuidad y ganas de aprender. Para la maestra, es una oportunidad para explicar qué es la IA y, sobre todo, qué no es.

Foto: Karolin Klüppel

Su experiencia reveladora la tuvo cuando su hijo, que entonces tenía 16 años, la llamó emocionado a su habitación. ChatGPT acababa de resolver todos sus deberes de matemáticas. En ese momento, dice van der Meer, se le cruzó un pensamiento que desde entonces no la ha abandonado: «A partir de mañana tengo que cambiar completamente mi forma de enseñar».

Los tiempos en que los profesores se situaban frente a la clase para transmitir contenidos han terminado definitivamente. Ahora los niños pueden aprender de forma autónoma, cada uno a su ritmo y a su manera. La tarea del profesor es acompañar ese proceso. «La relación personal es ahora incluso más importante que antes», dice van der Meer. «Tengo mucho más tiempo para dedicarme individualmente a los niños».

Para ella es fundamental que sus alumnos comprendan que la IA no sabe nada, sino que genera respuestas. Y que puede cometer errores. «Al final, siempre decide el ser humano», les insiste.

Cuando los alumnos han interiorizado esto, se crean las condiciones para los «momentos mágicos», como ella los llama. Por ejemplo, una alumna de segundo grado utiliza fotos de una excursión para crear un pódcast sobre flores tempranas. Una alumna de quinto grado aprende a hacer la voltereta lateral con ayuda de la IA. Y en un trabajo en grupo, unos alumnos de cuarto grado se dan cuenta de que el chatbot les ha propuesto ejemplos gramaticales incorrectos. Sin dudarlo, le explican ellos qué es el dativo.

El concepto de van der Meer está teniendo muy buena acogida. Recibe consultas de otros profesores. Su escuela, como única primaria dentro del concepto global, fue premiada con el premio escolar de IA. «Se percibe un espíritu de cambio», dice van der Meer. «La gente se da cuenta de que no puede resistirse a la nueva tecnología». Y está dispuesta a darle una oportunidad a la IA.

Traducción del alemán: Paolo Luers coin apoyo de ChatGTP

Este es contenido exclusivo para suscriptores de PAOLO. Accedé gratis si sos estudiante o estás desempleado/a. Tu lectura también es resistencia contra la censura. Suscribite ahora y unite a la comunidad de lectores críticos que hacen posible este espacio independiente.

%201.22.05%E2%80%AFp.m..png)